希沃如何下载Word版报告 方式1:希沃白板电脑端 - 左侧菜单栏“课堂反馈”- 找到对应报告 - 点击“更多”- 下载报告 方式2:希沃白板电脑端 - 打开课堂反馈报告-点击右上角“下载箭头” 方式3:希沃白板移动端

在实际使用中,Ollama本地大模型生成的内容往往差强人意,有时候生成速度也一言难尽,这时就需要调整一下模型参数。在 Ollama 中,模型参数主要用于控制模型的行为和推理过程。通过调整这些参数,你可以影响模型的输出质量、生成速度、资源占用等方面。 1、如何查看和修改Ollama模型参数 查看O

在前面的系列文章中我们了解了如何在自有的项目中集成Ollama大模型,同时也知道了如何根据项目自身情况自定义大语言模型,从而完成与项目的集成。现在我们进一步探讨Ollama的环境变量调优,使之可以充分调动本地机器的软硬件资源,以提升系统的性能。同时Ollama默认配置存在未授权访问与模型窃取等安全隐

在Ollama进阶过程中,我们通过前面的两篇文章了解了如何将Ollama大模型服务应用到自己的项目中,这使得Deepseek、QWQ之类的本地大模型有了具体的用途。 然而在实际的项目中,需求往往是千变万化的,一个大模型可能满足不了需求,甚至有时需要的也不一定是大模型,而是嵌入式模型、视觉模型、

在“Ollama进阶:在Python、Java、Go项目中集成Deepseek、QWQ大模型”一文中,我们讲到了在Java、Python、Go语言项目中整合Ollama中运行的Deepseek、QWQ、LLaMA、Mistral、Gemma本地大模型服务。本文则讨论在JavaScript(包括 No

在“Ollama入门:一键启动本地DeepSeek大模型”一文中,我们介绍了Ollama的基本使用方法,同时也推荐了ChatBox、Cherry Studio等AI智能客户端来完成文字、图片、语音等多模态输入,实现与 AI 的交互。 但是,仅仅这样常常不足以满足实际的需要,而在线版的Deeps

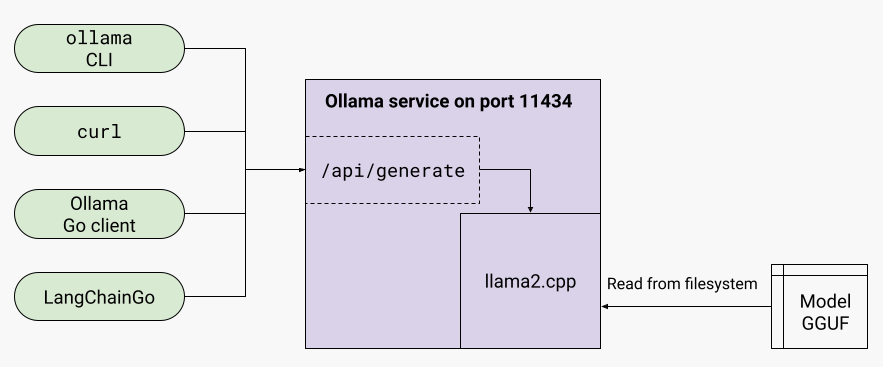

Ollama在AI大模型领域与风靡一时的应用容器引擎Docker有着相似的角色。对于熟悉Docker的小伙伴,接触到Ollama时就会发现Ollama 的 shell 命令和 Docker 极其相似,比如 Ollama 通过ollama pull下载模型、ollama run运行模型 ,类似 Doc

感谢“AI界拼多多”的DeepSeek,解开了“AI大模型”的神秘面纱,让普通笔记本也能跑起“大神们”的“神器”。当然在DeepSeek“一朝成名天下知”的其实早有默默耕耘的LLaMA、Qwen等等,以及能让这些大模型在本地电脑上一键启动的开源项目——Ollama。下面就一起来探一探这个通往AI大模

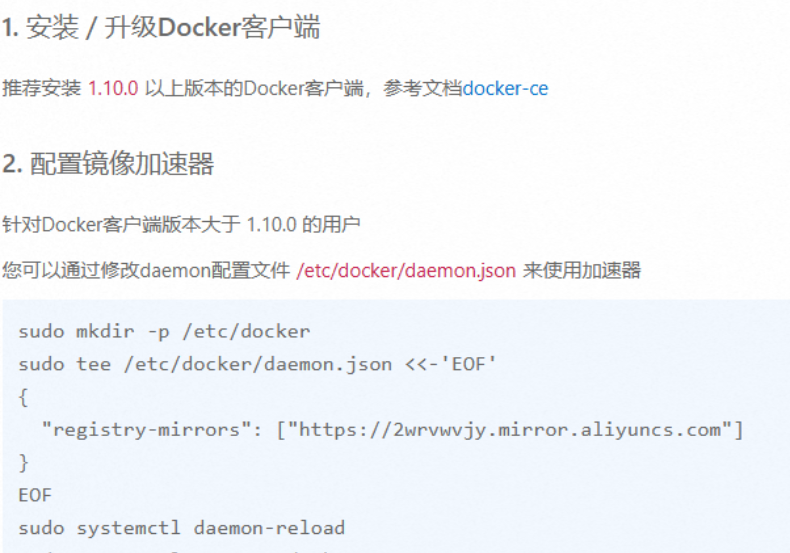

本人萌新,刚开始学习使用docker的时候出现了下面这条错误 docker: Error response from daemon: Get "https://registry-1.docker.io/v2/": net/http: request canceled while waiting f

TLS/SSL 弱密码套件漏洞是一种常见的安全问题,它可能导致加密通信被破解或降级攻击。修复此漏洞的关键是禁用不安全的密码套件,并配置服务器使用强密码套件。以下是修复步骤和详细说明: 1. 了解弱密码套件 弱密码套件通常包括以下类型: 使用弱加密算法(如 RC4、DES、3DES)。